Oto jak to zrobić.

Faza 1: Architektura – zanim dotkniesz narzędzi

Największy błąd to rzucanie się od razu do konfigurowania botów. Najpierw musisz zdefiniować przepływ informacji (data flow). Agent musi działać w tle, nasłuchiwać i wykonywać akcje, a nie być kolejnym chatem, z którym trzeba “gadać”.

Twój cel to Shadow PM – system, który obserwuje komunikację i aktualizuje stan projektu.

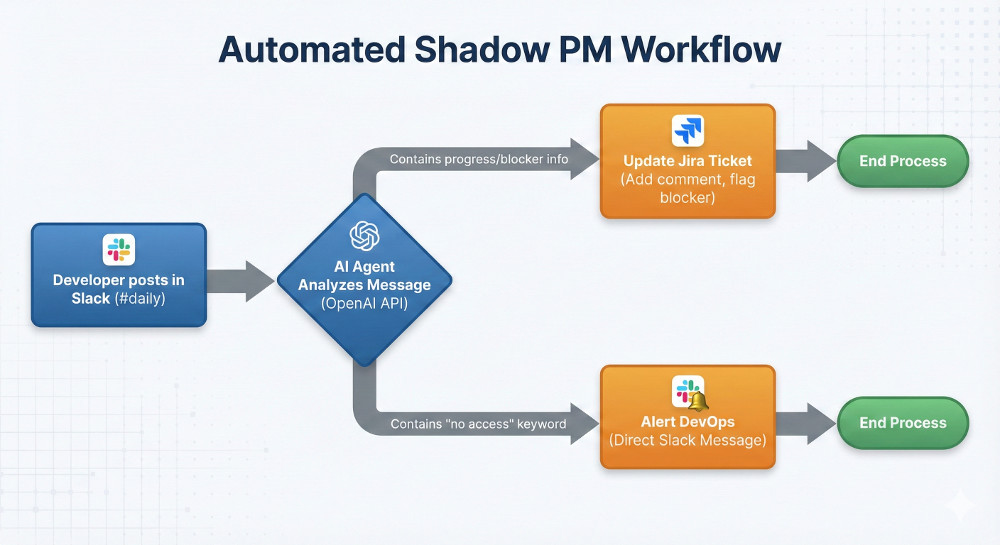

Przykładowy Workflow (Scenariusz bojowy):

- Trigger: Programista pisze na Slacku/Teams w kanale

#daily: “Zrobiłem API do logowania, ale czekam na front-end. Blokuje mnie brak dostępu do AWS”. - Procesowanie: Agent AI analizuje wpis.

- Akcja 1: Aktualizuje zadanie w Jirze (dodaje komentarz, oznacza bloker).

- Akcja 2: Wykrywa słowo kluczowe “brak dostępu” i wysyła ping do DevOpsa na prywatnym kanale.

Faza 2: Stack Technologiczny

Nie będziemy pisać backendu w Pythonie od zera. Użyjemy gotowych klocków, które łączą się przez API.

- Mózg: OpenAI Assistants API. Dlaczego to, a nie zwykłe GPT-4? Bo Assistants API ma wbudowaną “pamięć” (wątki) oraz narzędzie “File Search” (możesz wgrać mu PDF-y ze specyfikacją projektu, żeby wiedział, o czym mówi).

- Orkiestrator (Ręce): Make (dawniej Integromat) lub n8n. Make jest prostszy na start, n8n możesz postawić na własnym serwerze (ważne, jeśli masz restrykcyjne NDA).

- Interfejs: Twój obecny komunikator (Slack/Discord/Teams).

Faza 3: Budowa – Instrukcja operacyjna

Krok 1: Konfiguracja “Mózgu” (OpenAI Playground)

Wejdź w platformę OpenAI i stwórz nowego Asystenta. Kluczowa jest sekcja “Instructions”. Nie pisz “bądź pomocny”. Pisz jakbyś pisał specyfikację dla juniora:

“Jesteś asystentem technicznym projektu X. Twoim celem jest ekstrakcja konkretnych danych z luźnych rozmów.

1. Ignoruj wiadomości o kawie i pogodzie.

2. Jeśli wiadomość zawiera postęp prac -> sformatuj JSON do aktualizacji Jiry.

3. Jeśli wiadomość zawiera bloker -> sformatuj alert dla PM-a.

Nie zmyślaj faktów. Jeśli czegoś nie wiesz, pytaj.”

Wgraj do asystenta dokumentację projektu (User Stories, specyfikacja API). To jest jego baza wiedzy (RAG), dzięki której zrozumie kontekst, gdy ktoś napisze “API się wywaliło”.

Krok 2: Spięcie systemu (Make/n8n)

Tworzysz scenariusz w narzędziu automatyzującym.

- Moduł Slack (Watch Messages): Nasłuchuje na konkretnym kanale (np.

#projekt-dev). - Filtr: Puszczaj dalej tylko wiadomości, które nie są od botów.

- Moduł OpenAI (Message Assistant): Przesyłasz treść wiadomości do stworzonego wcześniej Asystenta.

- Router: Tutaj dzieje się magia. Na podstawie odpowiedzi AI, kierujesz ruch:

- Ścieżka A: Jeśli AI zwróciło JSON z aktualizacją taska -> Moduł Jira (Update Issue).

- Ścieżka B: Jeśli AI wykryło ryzyko -> Moduł Slack (Send Message) do Project Managera.

Krok 3: Output musi być maszynowy

LLM domyślnie “gada”. Ty potrzebujesz danych. W instrukcji dla modelu (System Prompt) wymuś format JSON lub użyj funkcji “Function Calling”.

Zamiast odpowiedzi: “Wygląda na to, że Marek skończył zadanie”, model ma zwrócić:

{

"action": "update_ticket",

"ticket_id": "PROJ-123",

"status": "In Review",

"comment": "Zakończono prace nad backendem."

}

Dzięki temu Twój scenariusz w Make/n8n wie dokładnie, co zrobić z tą informacją.

Faza 4: Pułapki i Rzeczywistość

Budowa to 20% sukcesu. Reszta to kalibracja.

- Koszty i Tokeny. Nie podpinaj Agenta pod każdy kanał “Off-topic”. Płacisz za każdy token przesłany do OpenAI. Jeśli podepniesz go pod kanał z memami, przepalisz budżet w tydzień. Agent ma działać tylko tam, gdzie toczy się praca.

- Halucynacje vs Fakty. Nigdy nie pozwalaj Agentowi na “kreatywne pisanie” w raportach dla klienta bez weryfikacji. Na początku ustaw tryb “Draft Only”. Niech Agent tworzy szkic maila lub komentarza, ale to człowiek klika “Wyślij”. Pełna autonomia to ryzyko wizerunkowe.

- “Human in the Loop”. Zautomatyzuj zbieranie danych, ale zostaw decyzyjność ludziom. Agent ma przygotować raport: “W tym sprincie mamy 15% opóźnienia w zadaniach backendowych”. Decyzję o przesunięciu wdrożenia podejmujesz Ty.

Podsumowanie: ROI

Zbudowanie takiego systemu w wersji MVP zajmie Ci około 6-8 godzin roboczych. Jeśli Twój zespół liczy 5 osób, a Ty spędzasz godzinę dziennie na synchronizacji statusów, odzyskujesz 5 godzin tygodniowo. W skali miesiąca to 20 godzin – czyli pół etatu.

To nie jest gadżet. To narzędzie do skalowania własnej efektywności. W biznesie wygrywa ten, kto szybciej przetwarza informacje i podejmuje decyzje, a nie ten, kto szybciej pisze na klawiaturze.